Kurumsal Ortamda LLM Kapasite Yönetimi

Günümüzde büyük dil modellerini (LLM) kurumsal ortamlarda konuşlandırmak, artık yalnızca bir kavram kanıtı olmaktan çıktı ve titiz bir mühendislik disiplini haline geldi. Ancak, bu tür sistemlerin gerçek dünya koşullarında ne kadar kullanıcıyı destekleyebileceğini doğru bir şekilde tahmin etmek, hâlâ zorlu bir görev olarak karşımıza çıkıyor.

Gerçek Kapasiteyi Anlamak

Sistem yöneticileri genellikle, vLLM gibi araçlarda parametre ayarlarının sistem performansını nasıl etkilediğini merak eder. Örneğin, –max-num-batched-tokens veya –gpu-memory-utilization gibi ayarların optimize edilip edilmediği veya sistemin gecikme sürelerini olumsuz etkileyip etkilemediği konusunda endişeler bulunmaktadır. Resmi belgeler bu ayarlamalar için mekanizmalar sunsa da, belirli bir iş yükü ve donanım yapısı için en uygun konfigürasyonu bulmak genellikle zordur.

Pratikte Bir Örnek: Yerel Bir AI Yardımcısı

Türk bir sistem yöneticisinin karşılaştığı bir senaryoda, bir kodlama asistanı olarak kullanılan bir AI modeli, binlerce kullanıcıya hizmet vermek üzere yapılandırılmıştır. Bu tür bir yapılandırmada, kullanıcıların gönderdiği isteklerin boyutu ve sıklığı, sistemin kaynaklarını nasıl yönettiğini doğrudan etkiler.

Standart Benchmark Sorunu

Standart benchmark testleri genellikle sabit bir giriş ve eşzamanlılık seviyesi kullanarak ortalama gecikme sürelerini raporlar. Ancak, gerçek dünya senaryolarında çok adımlı trafik simülasyonları gereklidir. Örneğin, bir kullanıcı kodlama görevleri için birçok takip sorusu sorduğunda, sistemin bu tür çok adımlı isteklerle nasıl başa çıkabileceğini anlamak kritik önem taşır.

Örnek: Kod Tabanı Analizi

Bir Türk yazılım şirketi düşünün; bu şirket, büyük kod tabanlarını analiz etmek için AI kullanıyor. Kullanıcıların %70’i küçük istekler gönderirken, %20’si orta boyutlarda ve %10’u ise tam kod tabanları gönderiyor. Bu, sistemin farklı şekillerde zorlanmasına neden olur ve yalnızca ortalama büyüklükteki istekleri dikkate alan bir benchmark, sistemin sınırlarını doğru tahmin edemez.

Ne İnşa Ettik

Geliştirdiğimiz beyaz kitap, üç ana aşamadan oluşan bir çerçeveyi tanımlar:

- İş Yükü Modelleme – Kullanıcı profilleri oluşturularak, gerçek kullanıcı davranışlarını simüle eden bir veri kümesi ile sistem test edilmiştir.

- Evrimsel Parametre Arama – Optuna NSGA-II kullanılarak, parametre alanında çoklu hedefli bir arama gerçekleştirilmiştir.

- Çekirdek Seviyesi Profil Oluşturma – NVIDIA Nsight Systems ile çekirdek seviyesinde izleme yapılarak, gerçek darboğazlar belirlenmiştir.

Örnek: Donanım Düzeyinde İzleme

Türkiye’de bir veri merkezi, sisteminin kapasitesini artırmak için NVIDIA’nın izleme araçlarını kullanarak GPU performansını detaylı bir şekilde analiz ediyor. Bu analizler, sistemdeki gerçek darboğazları ve potansiyel iyileştirme alanlarını belirlemekte yardımcı oluyor.

Kağıttan Öğrenecekleriniz

Beyaz kitap, aşağıdaki konulara dair hem bir referans hem de pratik bir kılavuz sunar:

- Gerçek kullanıcı davranışlarını yansıtan iş yükü simülasyonları tasarlama

- vLLM parametre alanını verimli bir şekilde aramak için çoklu hedefli optimizasyon kullanma

- Prometheus ve DCGM Exporter ile eşzamanlı görünürlük sağlama

- NVIDIA Nsight Systems ile çekirdek izlerini yakalama ve yorumlama

Sık Sorulan Sorular

LLM sunucum ne kadar kullanıcıyı destekleyebilir?

Her kurulumun benzersiz bir kombinasyonu olduğundan, doğru kullanıcı sayısını belirlemek için kendi sisteminize özel bir analiz yapmanız gerekir.

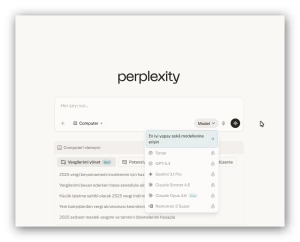

vLLM parametre ayarları nasıl optimize edilir?

Optuna gibi araçlar kullanarak, parametre alanında çoklu hedefli arama gerçekleştirebilirsiniz.

GPU kullanımı neden SLA metriği değildir?

Yüksek GPU kullanımı, sistemin diğer performans ölçütlerini olumsuz etkileyebilir ve SLA’yı karşılamayabilir.

VRAM kapasitesi her zaman bir darboğaz mıdır?

Hayır, sistemin performansı genellikle hesaplama gücü ve bellek bant genişliği ile sınırlı olabilir.

Sonraki Adım

Sisteminizin kapasitesini optimize etmek için beyaz kitabımızdaki metodolojiyi kendi kurulumunuza uyarlayın ve sonuçları gözlemleyin. En iyi sonuçlar, gerçek kullanıcılarınızı yansıtan testlerden elde edilir.

Kaynak: Windows Server – How Many Users Can Your LLM Server Really Handle?

Yorum gönder